Welche Anforderungen gibt die KI-Verordnung vor?

Mit zunehmendem Einsatz von künstlicher Intelligenz in Drittdienstleistungen erweitert sich das Spektrum der zu bewertenden Risiken. Neu ist, dass auch die eingesetzten KI-Systeme einer eigenständigen Risikobewertung unterzogen werden müssen.

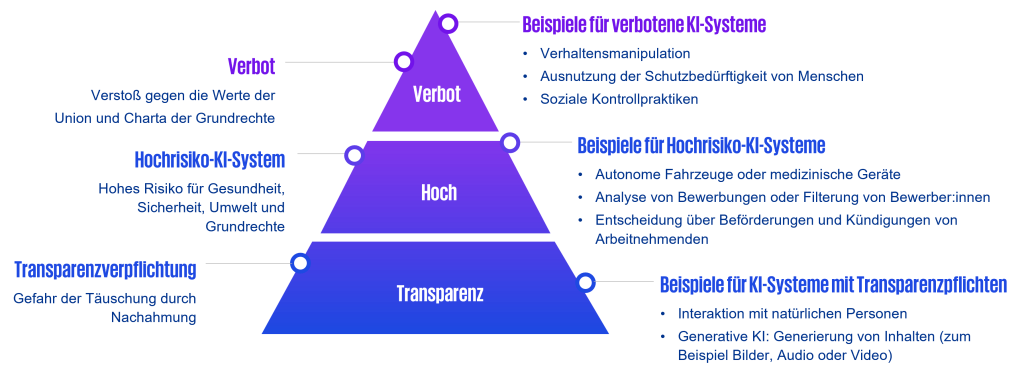

Die KI-Verordnung folgt einem risikobasierten Ansatz und ordnet Akteuren je nach Risikoklassifizierung unterschiedliche Pflichten zu. Hierbei kann auf die Risikoanalyse des bestehenden Outsourcing-Prozesses zurückgegriffen werden, der um eine spezifische Risikoklassifikation für KI-Systeme ergänzt wird.

Es gilt zu klären, ob es sich bei der Dienstleistung um ein reguliertes KI-System handelt, welche Risikoklasse zutrifft und welche damit verbundenen Pflichten erfüllt werden müssen. Weiterhin sind auch Datenschutz- und Informationssicherheitsaspekte im Rahmen des KI-Einsatzes zu bewerten.

Risikoklassifizierung von KI-Systemen nach der EU-KI-Verordnung

Quelle: KPMG in Deutschland, 2025

Welche neuen Anforderungen gibt es für Verträge?

Auch die vertragliche Ausgestaltung gewinnt an Bedeutung. Künftig sollten Dienstleisterverträge ausdrücklich Regelungen enthalten, die sich auf die Einhaltung der KI-Verordnung beziehen – etwa zur technischen Dokumentation, zu Prüf- und Zugriffsrechten, zur Sicherstellung der Datenqualität und zu Meldepflichten im Fall von Störungen oder Fehlverhalten der KI-Systeme.

Sollten KI-Systeme im Rahmen der eingekauften Dienstleistung eingesetzt werden, sollten vertragliche Vereinbarungen im Rahmen des Drittparteienrisikomanagements ausdrücklich regeln, ob und in welchem Umfang künstliche Intelligenz bei der Erbringung der Dienstleistung eingesetzt wird.

Das gilt insbesondere dann, wenn der KI-Einsatz für den Auftraggeber nicht unmittelbar erkennbar ist. Dabei sind Transparenz über die Art des KI-Systems, dessen Funktionsweise sowie potenzielle Risiken essenziell.

Änderungen am eingesetzten KI-Modell, etwa durch Updates, Retraining oder den Austausch des Systems, sollten einer vorherigen Informationspflicht und gegebenenfalls einer Zustimmungspflicht unterliegen.

Welche Abteilungen müssen zusammenarbeiten?

Um einen sicheren Einsatz von KI-Systemen zu gewährleisten, ist es unerlässlich, dass Fachabteilungen wie Compliance, Datenschutz, Risikomanagement und IT eng mit dem Drittparteienrisikomanagement zusammenarbeiten – typischerweise bildet das TPRM dabei die übergreifende Klammer und Koordinationsfunktion.

Der Aufbau interner Kompetenzen zur Beurteilung und Überwachung KI-relevanter Sachverhalte ist dabei ebenso notwendig wie eine enge Abstimmung mit dem Einkauf, der Rechtsabteilung und der internen Revision.

TPRM als Schlüssel zur KI-Compliance: Finanzdienstleister sollten jetzt aktiv werden

Die KI-Verordnung verändert nicht nur den Umgang mit künstlicher Intelligenz, sondern hat direkte Auswirkungen auf das Outsourcing. Finanzdienstleister können die Verantwortung nicht an Dritte abgeben – sie müssen sicherstellen, dass ausgelagerte KI-Systeme transparent, sicher und regelkonform eingesetzt werden.

Dazu gehört es:

- KI-Risiken in das TPRM zu integrieren und regelmäßig zu bewerten.

- Verträge mit klaren Regelungen zu Dokumentation, Prüf- und Zugriffsrechten sowie Meldepflichten auszustatten.

- Interne Kompetenzen und Governance-Strukturen aufzubauen, um den Einsatz von KI-Systemen wirksam zu steuern.

Wer KI nutzt – insbesondere durch Drittanbieter – muss die Regelkonformität aktiv und nachvollziehbar sicherstellen. Eine vorausschauende Integration der KI-Verordnung in das Drittparteienrisikomanagement ist daher nicht nur regulatorische Pflicht, sondern strategische Notwendigkeit. Sie lässt sich durch den Aufbau einer umfassenden KI-Governance (wie hier beschrieben) und den gezielten Ausbau von KI-Kompetenzen absichern.